Modelos Markov Chain Monte Carlo (MCMC)-Previsão de gols de futebol

Cadeia de Markov Monte Carlo (MCMC) é um método estatístico usado para amostragem de distribuições de probabilidade complexas. Embora o MCMC não seja um método de previsão direta, ele pode ser usado em combinação com modelos hierárquicos bayesianos para estimar parâmetros e fazer previsões, como o número de gols de futebol em uma partida.

Aqui está um esboço geral de como usar o MCMC em combinação com um modelo hierárquico bayesiano para prever gols de futebol:

Colete dados históricos: Reúna dados sobre partidas anteriores, incluindo o número de gols marcados por cada equipe, suas forças de ataque e defesa, vantagem em casa e outros fatores relevantes que podem influenciar a pontuação de gols.

Defina o modelo hierárquico bayesiano: Configure um modelo hierárquico bayesiano usando preditores relevantes. Os preditores comuns incluem força da equipe (ataque e defensiva), vantagem em casa e recordes de confronto direto. Em uma estrutura bayesiana, você definiria distribuições anteriores para cada um desses parâmetros, com base no conhecimento do domínio ou usando antecedentes não informativos se pouco se souber sobre os parâmetros.

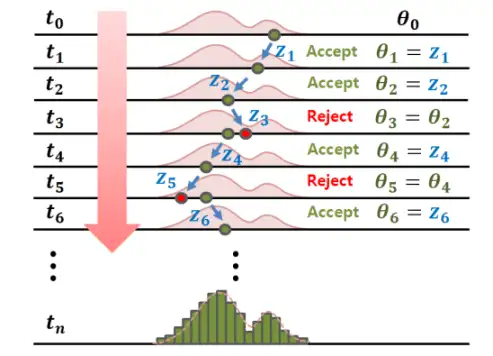

Estimativa de parâmetros usando MCMC: Use algoritmos MCMC como a amostragem Metropolis-Hastings ou Gibbs para amostrar a partir da distribuição posterior dos parâmetros dados. Este processo ajuda a estimar a distribuição dos parâmetros condicionados aos dados observados.

Faça previsões: use a distribuição posterior dos parâmetros para fazer previsões para uma próxima partida. Você pode fazer isso amostrando a partir da distribuição preditiva do número de gols para cada equipe, dados os parâmetros estimados. Isso fornecerá a você uma gama de resultados possíveis e suas probabilidades associadas.

Avalie a precisão: compare suas previsões com os resultados reais das correspondências para avaliar a precisão do seu modelo. Refine seu modelo conforme necessário, ajustando variáveis preditoras, distribuições anteriores ou incorporando dados adicionais.

A vantagem de usar MCMC em combinação com um modelo hierárquico bayesiano é que ele fornece uma estimativa mais robusta dos parâmetros, contabilizando a incerteza nos valores dos parâmetros. Além disso, ele permite que você incorpore conhecimentos ou crenças anteriores sobre os parâmetros, o que pode melhorar as previsões quando os dados são limitados.

No entanto, os modelos baseados em MCMC podem ser intensivos em computação, especialmente com grandes conjuntos de dados ou modelos complexos. Isso pode torná-los mais lentos e mais desafiadores de implementar do que métodos mais simples, como regressão de Poisson.

Vamos demonstrar um exemplo simplificado do uso de um algoritmo Markov Chain Monte Carlo (MCMC) em combinação com um modelo hierárquico bayesiano para prever gols de futebol em uma próxima partida entre o Time A e o Time B.

Coletar dados históricos: Suponha que tenhamos os seguintes dados das últimas cinco partidas para ambas as equipes:

Gols da equipe A: 2, 1, 0, 3, 1

Gols da equipe B: 1, 2, 2, 0, 1

Defina o modelo hierárquico bayesiano: Para este exemplo, consideraremos um modelo simples em que o número de gols marcados por cada equipe segue uma distribuição de Poisson com um parâmetro lambda (λ). Assumiremos que o lambda para cada equipe segue uma distribuição Gamma com os parâmetros alfa (α) e beta (β). Na prática, você deve incorporar fatores adicionais como força da equipe, recordes frente a frente, etc.

Configurar distribuições anteriores: escolheremos antecedentes não informativos para os parâmetros α e β da distribuição Gamma. Por exemplo, podemos usar α = β = 1.

Estimativa de parâmetros usando MCMC: Aplique um algoritmo MCMC (por exemplo, amostragem Metropolis-Hastings ou Gibbs) para amostrar a partir da distribuição posterior dos parâmetros dados os dados observados. Nesta etapa, o algoritmo MCMC gera iterativamente amostras de lambda (λ) para cada equipe, levando em consideração os dados observados e as distribuições anteriores.

Faça previsões: Depois de obter as amostras da distribuição posterior de lambda (λ) para cada equipe, use essas amostras para gerar previsões para o número de gols na próxima partida. Por exemplo, se as amostras posteriores para lambda do Time A (λ_A) forem [1,6, 1,5, 1,7, 1,4, 1,6], você pode calcular a distribuição preditiva para o número de gols marcados pelo Time A por amostragem de uma distribuição de Poisson com cada valor lambda.

Avalie a precisão: Após a partida, compare o número previsto de gols com o número real de gols marcados. Acompanhe a precisão da previsão ao longo do tempo e refine o modelo conforme necessário.

Este exemplo demonstra as etapas básicas envolvidas no uso do MCMC com um modelo hierárquico bayesiano para previsão de gols de futebol. Lembre-se de que este exemplo é simplificado e você deve incluir mais variáveis de preditor e usar um conjunto de dados maior para previsões mais precisas. Além disso, os algoritmos MCMC podem ser computacionalmente intensivos, portanto, implementá-los na prática pode exigir otimização adicional ou recursos de computação mais poderosos.